Kto decyduje, co widzńô w czasie pandemii?

Natalia Mileszyk udostńôpnia na Facebooku artykuŇā dotyczńÖcy koronawirusa. A raczej pr√≥buje. Na ekranie pojawia sińô bowiem komunikat ‚Äěpost niezgodny ze standardami spoŇāecznoŇõci dotyczńÖcymi spamu‚ÄĚ. Pytamy wińôc - kto decyduje, co widzimy w czasie pandemii?

Pr√≥bowaŇāam na swoje konto na Facebooku wrzucińá link do tekstu ‚ÄěO farmaceutce, sprincie, maratonie i boŇľku produktywnoŇõci w czasie pandemii‚ÄĚ o tym, jak w tym szaleŇĄstwie byńá dla siebie dobrńÖ. Algorytm filtrujńÖcy treŇõńá miaŇā jednak inne zdanie na temat artykuŇāu ‚Äď na moim ekranie pojawiŇā sińô komunikat ‚Äěpost niezgodny ze standardami spoŇāecznoŇõci dotyczńÖcymi spamu‚ÄĚ. Kt√≥ry punkt regulaminu zostaŇā zŇāamany? Tego nie wyjaŇõniono. Posta nie bńôdzie. I tyle.

Koronawirus, pierwsza infodemia ‚Äď epidemia informacyjna ‚Äď kaŇľe nam przemyŇõleńá model dostńôpnoŇõci treŇõci w internecie. I to nie tylko z perspektywy dezinformacji i fake-news√≥w, ale r√≥wnieŇľ w kontekŇõcie tego, kto sprawuje w dzisiejszych czasach kontrolńô nad wiedzńÖ i informacjńÖ – czyli ma wŇāadzńô.

Cyfrowa cenzura w rńôkach paŇĄstwa

W Chinach, gdzie wszystkie firmy technologiczne ŇõciŇõle wsp√≥ŇāpracujńÖ z rzńÖdem, WeChat (najpopularniejszy komunikator) cenzurowaŇā informacje o Covid-19 juŇľ od poczńÖtku roku ‚Äď na dŇāugo przed tym, jak informacja o pandemii zostaŇāa podana do publicznej wiadomoŇõci.¬†

ChiŇĄski przypadek m√≥wi duŇľo o cenzurze w paŇĄstwach autorytarnych ‚Äď jest ona w biaŇāych rńôkawiczkach, bez Ňõlad√≥w dziaŇāalnoŇõci paŇĄstwa, z wykorzystaniem technologii cyfrowych. Ale teŇľ nie pozostaje ona niezauwaŇľona przez spoŇāecznoŇõńá internaut√≥w, kt√≥ra ma dostńôp do wielu Ňļr√≥deŇā, moŇľe teŇľ Ňāatwo sińô komunikowańá i wymieniańá obserwacjami dotyczńÖcymi cenzury. UŇľytkownicy WeChat znajdujńÖ kreatywne sposoby, by dzielińá sińô blokowanymi treŇõciami (np. wstawiajńÖc mińôdzy litery emotikonki).¬†

Wuhan doctor Ai Fen shares her own story of being disciplined for sharing early December 2019 diagnostic reports on the coronavirus — and web users fight to keep it alive online, even resorting to telegram codes. https://t.co/yLAxVc2Kne pic.twitter.com/NRcbaQVdWP

‚ÄĒ China Media Project (@cnmediaproject) March 11, 2020

Prywatyzacja informacji

Wszystkie media spoŇāecznoŇõciowe (na r√≥ŇľnńÖ skalńô) filtrujńÖ treŇõci zamieszczane przez uŇľytkownik√≥w ‚Äď zar√≥wno ze wzglńôdu na potencjalne naruszenia prawa (np. rozpowszechnianie pornografii dziecińôcej), jak i zgodnoŇõńá ze standardami danej spoŇāecznoŇõci. Filtrowanie ma dwutorowy charakter ‚Äď prowadzone jest zar√≥wno przez ludzi, jak i algorytmy.

RzeczywistoŇõńá wyglńÖda wińôc tak ‚Äď wszyscy korzystamy z medi√≥w spoŇāecznoŇõciowych, a parńô korporacji dominujńÖcych na rynku decyduje o dostńôpnych dla nas treŇõciach. Problem tylko narasta,¬† gdy ludzie zostajńÖ wyjńôci z systemu filtrowania treŇõci ‚Äď np. gdy w zwińÖzku z zagroŇľeniem epidemiologicznym nie mogńÖ przychodzińá do pracy. W poniedziaŇāek Facebook ogŇāosiŇā,¬† Ňľe moderatorzy treŇõci nie muszńÖ przychodzińá do biura.

Wtorkowy efekt? Na caŇāym Ňõwiecie podniosŇāy sińô gŇāosy, Ňľe Facebook nie pozwala na zamieszczanie legalnych treŇõci dotyczńÖcych Covid-19 z takich stron jak Business Insider, BuzzFeed, The Atlantic i the Times of Israel. Nie wiadomo, z czego wynikaŇā bŇāńÖd, buga juŇľ naprawiono ‚Äď ale bez odpowiedzi pozostaje pytanie, jak ten incydent wpŇāynńÖŇā na dostńôp do informacji. Facebook w czasach zarazy peŇāni r√≥Ňľnorakie funkcje, od miejsca gdzie ludzie szukajńÖ informacji, po platformńô gdzie artyŇõci zbierajńÖ pienińÖdze na przetrwanie swoich inicjatyw.

Koronawirus odsŇāoniŇā bezlitoŇõnie jeszcze jedno zagroŇľenie zwińÖzane z obecnym modelem funkcjonowania medi√≥w spoŇāecznoŇõciowych ‚Äď monetyzowanie treŇõci kontrowersyjnych. Do tej pory nie jest jasne, kt√≥ra korporacja i w jaki spos√≥b pozwala na zarabianie na treŇõciach dotyczńÖcych Covid-19 (kt√≥re oczywiŇõcie sńÖ bardzo popularne), czy teŇľ w jaki spos√≥b targetowane sńÖ reklamy np. maseczek ‚Äď na co zwr√≥cili uwagńô w Stanach Zjednoczonych senatorowie Warner and Blumenthal.

SpoŇāecznoŇõńá dbajńÖca o prawdńô

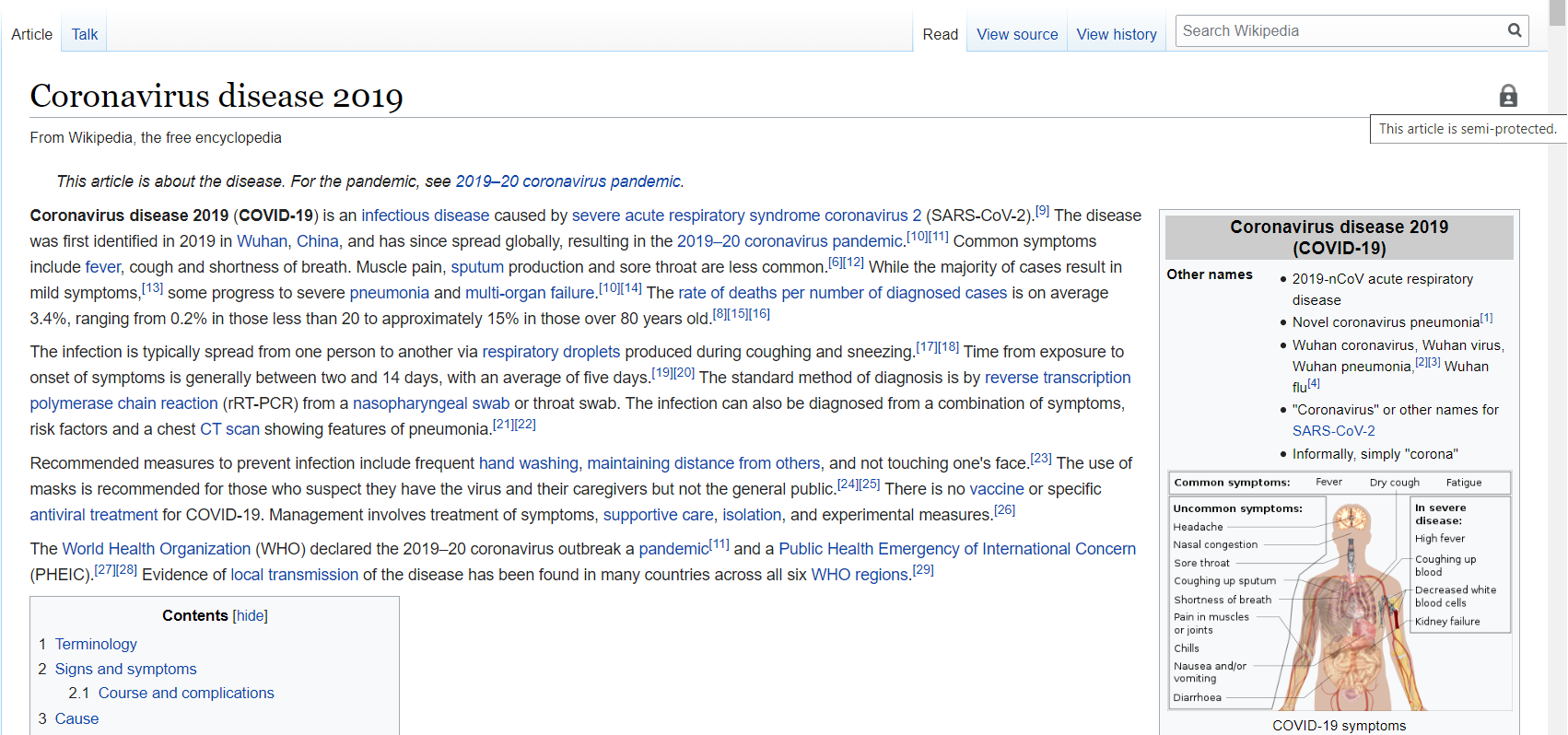

ZupeŇānie inny model zarzńÖdzania treŇõciami ma Wikipedia ‚Äď najwińôkszy spoŇāecznoŇõciowy projekt dzielenia sińô wiedzńÖ. I wŇāaŇõnie aspekt spoŇāecznoŇõciowy, kiedyŇõ przez wielu uznawany za najwińôkszńÖ wadńô projektu, w czasach kryzysu okazuje sińô jego najwińôkszńÖ zaletńÖ.

Co waŇľne, model funkcjonowania Wikipedii nie zmieniŇā sińô z powodu pandemii (chońá zapewne wzroŇõnie liczba edycji, bo sporo os√≥b zostaŇāa uziemionych w domu). JuŇľ dawno spoŇāecznoŇõńá uznaŇāa, Ňľe informacje medyczne powinny byńá szczeg√≥lnie sprawdzane ‚Äď z tego zaŇāoŇľenia powstaŇāa inicjatywa WikiProject Medicine ‚Äď wpisy o Covid-19 sńÖ jej czńôŇõcińÖ. 35,000 artykuŇā√≥w na tematy medyczne jest sprawdzanych przez 150 edytor√≥w z wiedzńÖ medycznńÖ.¬†

SpoŇāecznoŇõńá Wikipedii stawia sprawńô jasno ‚Äď sńÖ kwestie waŇľne i waŇľniejsze, a zdrowie publiczne zalicza sińô do tych drugich. Dlatego teŇľ zdecydowano sińô na wprowadzenie inicjatywy WikiProject Medicine i szczeg√≥lne wysokie standardy edycji. Korporacje dotychczas stosujńÖ jednolite systemy moderacji treŇõci, bez wzglńôdu na spoŇāeczne skutki dezinformacji w r√≥Ňľnych tematach.

Ale nie tylko standardy edycji sńÖ gwarantem sukcesu jeŇõli chodzi o zwalczanie dezinformacji ‚Äď dokumentowanie tego zjawiska teŇľ peŇāni kluczowńÖ rolńô w budowaniu kultury zaufania (a nie zamiatania temat√≥w pod dywan). WikipedyŇõci dokumentujńÖ r√≥wnieŇľ teorie spiskowe wok√≥Ňā Covid-19, w tym r√≥wnieŇľ te rozpowszechniane przez rzńÖd USA (‚ÄěMisinformation by governments/United States‚ÄĚ).

Wińôcej wsp√≥lnoty = wińôcej informacji

W ferworze walki z wirusem wszyscy myŇõlńÖ o jego dŇāugofalowych skutkach, szczeg√≥lnie w kontekŇõcie kryzysu ekonomicznego. Ale moŇľliwe sńÖ r√≥wnieŇľ pozytywne scenariusze (takńÖ przynajmniej mam naiwnńÖ nadziejńô). WyobraŇľam sobie, Ňľe na nowo jako spoŇāeczeŇĄstwo przypomnimy sobie o wartoŇõci wiedzy i informacji (jak chociaŇľby Wielka Brytania, kt√≥ra jednak postanowiŇāa zmienińá swojńÖ odpowiedŇļ na pandemińô r√≥wnieŇľ na bazie danych z WŇāoch) i o zaletach, jakie pŇāynńÖ z jej dostńôpnoŇõci i otwartoŇõci (naukowcy od tygodni dzielńÖ sińô wynikami swoich badaŇĄ dotyczńÖcych COVID-19 na niespotykanńÖ dotńÖd skalńô).¬†

Ale w dzisiejszych czasach nie wystarczy myŇõleńá o treŇõciach w kontekŇõcie ich otwartoŇõci i dostńôpnoŇõci ‚Äď r√≥wnie waŇľne jest pytanie, kto informacjami zarzńÖdza i decyduje o tym, co jest prawdńÖ, a co nie. Dotychczasowa historia pandemii pokazuje, Ňľe nie zawsze paŇĄstwo stoi na straŇľy dostńôpu do wiedzy, a prywatne korporacje mogńÖ w nadgorliwoŇõci filtrowania Ňāatwo godzińá sińô na blokowanie treŇõci przypadkowych (overblocking). MoŇľe wińôc odpowiedzińÖ sńÖ modele wsp√≥lnotowe zarzńÖdzania wiedzńÖ ‚Äď tak ŇľebyŇõmy w czasach kolejnego kryzysu nie musieli sińô martwińá o jakoŇõńá i rzetelnoŇõńá informacji, a mogli skupińá sińô na konkretnych dziaŇāaniach.

Natalia Mileszyk @nmileszyk¬†–¬†prawniczka, zajmujńÖca sińô prawami cyfrowymi, reformńÖ prawa autorskiego i politykami otwartoŇõciowymi. CzŇāonkini Stowarzyszenia Communia na rzecz domeny publicznej, gdzie koordynuje zesp√≥Ňā rzeczniczy oraz ekspertka prawnego Creative Commons Polska.

————————

Tekst ukazaŇā sińô w Biuletynie SpoŇāTech. Dwa razy w miesińÖcu dzielimy sińô z Wami najwaŇľniejszymi informacji i przemyŇõleniami zwińÖzanymi ze spoŇāecznym wymiarem technologii.

JeŇõli chcesz wiedzieńá, jak technologia oddziaŇāuje na ludzi i spoŇāeczeŇĄstwo ‚Äď zapisz sińô na newsletter.